Nvidia a annoncé le prix de son prochain GPU pour l’IA et le HPC, le Blackwell B200. Ce dernier se situera entre 30 000 et 40 000 dollars, mais il est important de noter que Nvidia préfère vendre des solutions complètes pour les centres de données plutôt que des composants individuels.

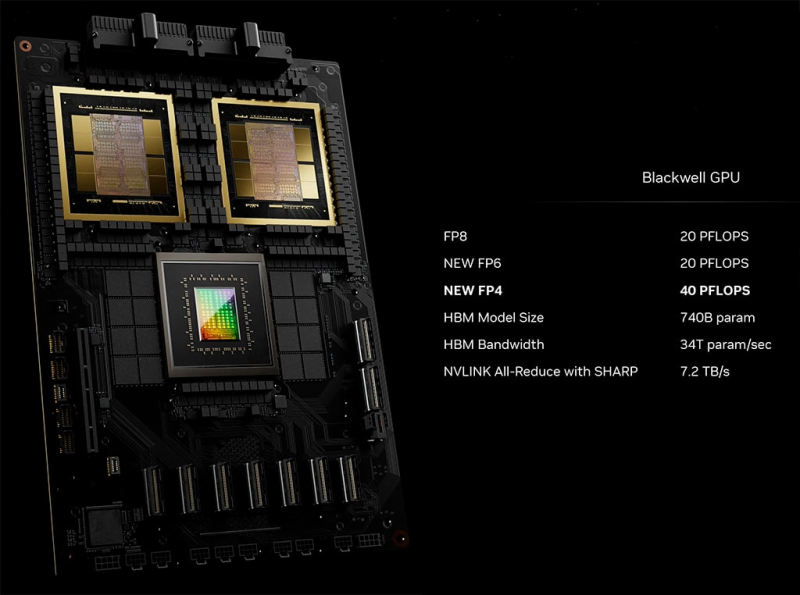

Le B200 est une puce puissante dotée de 192 Go de mémoire HBM3E et d’une architecture bi-die qui lui permet d’atteindre des performances élevées. Cette conception explique son coût plus élevé par rapport au H100, qui est une solution mono-die avec 80 Go de mémoire.

Le développement du B200 a nécessité des investissements importants de la part de Nvidia. Le PDG de la société a déclaré que Nvidia a dépensé plus de 10 milliards de dollars dans la conception de ses architectures et designs GPU modernes.

Il est important de noter que le B200 n’est pas un produit vendu au détail. Nvidia le destine plutôt aux centres de données et aux clients qui ont besoin de solutions de calcul haute performance. La société propose des serveurs DGX B200 équipés de huit GPU Blackwell et des SuperPODs DGX B200 regroupant 576 B200.

Le prix du B200 est élevé, mais il s’agit d’une puce puissante qui offre des performances élevées pour les applications d’IA et de HPC. Nvidia s’oriente vers la vente de solutions complètes pour les centres de données plutôt que de composants individuels. Le Blackwell B200 de Nvidia est actuellement le GPU le plus cher du marché, avec un prix de départ de 30 000 $.

source